再无隐私

【川透社摘译报道】在生成式 AI 时代,您无法跟踪信息的去向或用途。这不是你的错。

2010年,马克·扎克伯格在一次TechCrunch颁奖典礼上告诉观众,年轻人,尤其是社交媒体用户,不再关心隐私。他说:“人们已经变得非常习惯于某些行为,如,不仅分享更多不同类型的信息,而且更加公开地和更多人分享。”以前人们会认为,即当个人透露自己的信息时,侵犯隐私就会发生。换句话说,如果你在 Reddit 或 TikTok 分享一些个人信息结果突然火了,或者向喜欢的人发了一张裸照后被转发到其他人手里,那就是你的错。这种个人责任模式由来已久,但在生成 AI 时代完全不可行,也无关紧要。

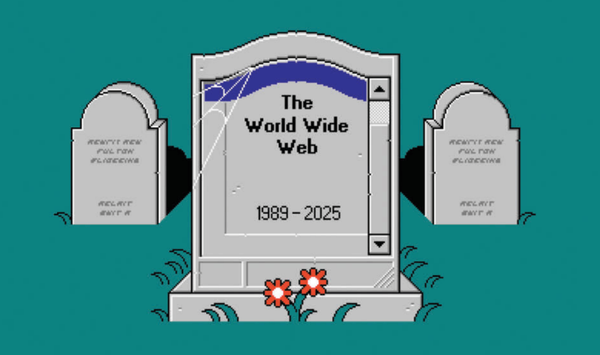

科技公司在未经同意甚至未经通知的情况下,大量收集数字信息,并将其汇集到数据集中以训练他们的人工智能。随着这些公司争先恐后地将人工智能集成到每一个可以想象的产品中,从搜索引擎到游戏,我们无法知道输出结果将去向何方,或者可能如何被解读。在此之前,早期的数据经纪人,也抓取网络并收集大量关于个人的档案,这些输出不能免费提供给普通互联网用户,也不集成到搜索引擎和文本处理器中。不受限制的访问加剧了潜在的隐私侵犯,并使更多人面临有害后果。

生成式人工智能得以训练的大规模数据集中,不可避免地包含了人们并不打算分享或者甚至不知道可以被这种方式使用的信息。关于婚姻、抵押贷款和选民登记的公共记录都是潜在的数据来源;新闻报道、员工简介和维基百科页面也是如此。但这个混合物般的数据集还包含了数百万张照片和视频。Dall-E是通过从社交媒体、搜索引擎和图像托管网站收集的图像进行训练的。如果你在2007年的Flickr照片背景中出现,你的形象可能被用来训练算法。似乎没有人确切知道数据混合物中包含了什么,个人也无法监督或控制它。当ChatGPT为我写了一个不准确的个人简介时,我既不知道它哪里获取的错误信息,也无法知道正确的信息是如何收集出来的。我们习惯于将隐私视为个人对信息的控制,但如果连个人数据的来源都不知道,就无法监管个人数据的使用方式。

人类学家和法学专家多年来一直强调,个人再也无法控制隐私,部分原因是我们是在网络中共享信息。换句话说,人们在线上和现实生活中都在谈论彼此,没有简单的方法来限制这一点。你可以要求朋友不在Instagram上发布你孩子的照片或在TikTok上提到你,但你只能隐私程度取决于与你聊天最多的联系人的隐私水平。网络隐私侵犯通常发生,因为在特定规范和期望的环境中共享的数据会被转移到其他地方并以不同方式解读。

在过去十年左右的时间里,新技术越来越多地损害了我们的网络隐私。法证家族史让警方可以通过检查远房亲戚的基因证据来找出罪犯。你当然可以选择不用Ancestry.com,但是你可管不了远房表亲会不会用。而大数据经常会把朋友,亲戚,甚至短暂相识都扯进来,这种预判式警务或风险评估的算法里更加让人担心。没辙啊,这种侵犯隐私的事情谁也管不了。

生成式人工智能让大家更担心隐私问题。它打乱了我们保持可接受隐私水平所需要的方法和策略。毕竟,生成式人工智能的输出与它们的来源完全分离,这是以前无法想象的。有人泄露私人短信是一回事,而整个Reddit被用作机器人诗歌和大学论文的素材又是另一回事。在特定情况下提供的信息可能会被重新背景化和混合,改变其含义并违反哲学家海伦·尼森鲍姆所称的“上下文完整性”。试问,作为一个个体的人如何可以避免这种情况呢?

更重要的是,生成式人工智能可以实现各种创造性的隐私侵犯。我无法让 ChatGPT 给我我丈夫的地址(我们住在一起),但它却很高兴地指导如何在网上找到我家的住址。深度伪造完全是另一个问题:还有什么比模仿另一个人的风格、面孔甚至言论更侵犯隐私的呢?我把我的一些声音录音上传到一个名为Descript的工具上,几个小时后就有了一个合成版本,可以用它来表达任何事情。一些被广泛使用的AI工具有防范措施来防止极端侵犯隐私的情况发生,但有些则没有。人工智能可以访问数据,如果不择手段地使用这些数据,可以绘制出某人的整个社交网络,将他们的财务状况和健康问题拼凑在一起,并确定他们是否特别容易受到诈骗的影响。

虽然我知道现在人工智能被炒作得很火,但是生成式人工智能和其他有隐私底线的科技还是有很大区别。社交平台是由特定实体控制的,我们可以理解它们的运作方式。然而,连研究和建造ChatGPT等大型语言模型的人们,都不完全了解其真正运作原理。科技公司正争相开发新的人工智能产品,这些产品将被应用于伦理标准与我们不同的人群中。生成式AI的各种作品展示了传统的,以个人责任为模式的隐私观念有多么无力,是时候停止指责那些受害者了。【全文完】